Claude und Datenschutz/DSGVO für Blogger

KI-Tools wie Claude von Anthropic sind aus dem Arbeitsalltag vieler Selbstständiger und Unternehmen nicht mehr wegzudenken. Sie helfen beim Schreiben von Texten, der Analyse von Daten, der Beantwortung von Kundenfragen und vielem mehr. Doch mit dem Einsatz von KI-Tools kommen auch wichtige Datenschutzfragen auf – besonders für alle, die mit agentischen KI-Tools arbeiten und die in Europa tätig sind und unter die DSGVO fallen. Die KI-Technologie schreitet rasend schnell voran und kaum jemand hat bisher wirklich durchdacht, was es bedeutet, wenn KI-Agenten z. B. im eingeloggten Web-Backend arbeiten, wie das Claude Cowork kann. In diesem Artikel beantworte ich die häufigsten Fragen rund um das Thema Claude und Datenschutz, die v. a. für Blogger relevant sind.

Hinweis: Dieser Artikel stellt keine Rechtsberatung dar. Bei konkreten rechtlichen Fragen wende dich bitte an eine qualifizierte Datenschutzberatung oder einen Rechtsanwalt. Das hier ist mein aktueller Wissensstand und ich werde diesen Blogartikel nach bestem Wissen aktuell halten.

Datenschutz und Claude:

Kommentare sind bei Blogs die größte Datenschutz-Falle.

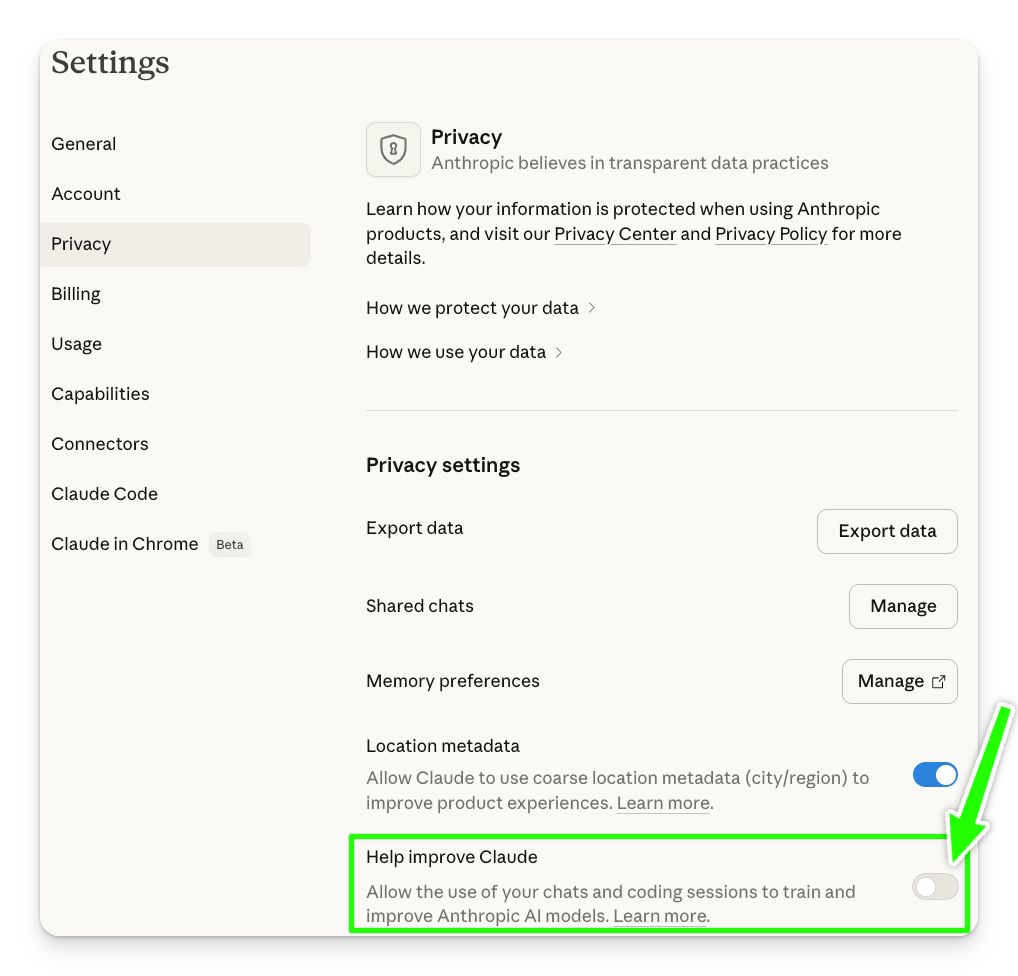

Opt-out ist Pflicht: Lass Claude deine Daten nicht für das Training seiner Modelle verwenden.

Pro-Account ≠ DSGVO-Schutz: Wer Claude mit einem Free- oder Pro-Account nutzt (also die meisten Blogger), hat keinen Auftragsverarbeitungsvertrag (AVV) mit Anthropic.

Keine Kundendaten ohne Rechtsgrundlage: Fotos, E-Mail-Adressen oder Bestelldaten von Kunden dürfen nur mit gültiger Rechtsgrundlage in Claude eingegeben werden. Meistens ist das die ausdrückliche Einwilligung. Und meistens haben wir diese Einwilligung nicht.

Datenschutzerklärung anpassen: Wenn du Claude geschäftlich nutzt und dabei (auch unbeabsichtigt) personenbezogene Daten verarbeitest, musst du Anthropic als Dienstleister in deine Datenschutzerklärung aufnehmen.

Dir gefällt, was du liest? Abonniere meinen Blog – mit meinem Newsletter!

Als ChatGPT Ende 2022 auf den Markt kam, war ich sofort begeistert: Wow, was für eine digitale Revolution sich da direkt vor meinen Augen entfaltet hat! Ich habe mit ChatGPT viel experimentiert und habe den KI-Chatbot quasi als mächtigeren Google-Ersatz genutzt. Relativ schnell habe ich eigene CustomGPTs erstellt, z. B. für das Brainstorming von neuen Blogartikel-Ideen oder um geniale Claims zu entwickeln. Diese CustomGPTs nutze ich immer noch in meinen Blog-Kursen. Aber: Ich habe ChatGPT immer nur in der normalen Browser-Version benutzt: Ich habe dort meine Prompts reingeschrieben und mit ChatGPT z. B. Texte für Social-Media-Postings oder Werbeanzeigen geschrieben, die ich dann aus dem ChatGPT-Tab wieder herauskopiert habe, um sie woanders wieder einzufügen. Mehr habe ich mit ChatGPT nicht gemacht, denn zum einen war ChatGPT für mich nicht so „zugänglich“ (der OpenAI-Browser „Atlas“ war mir zu umständlich) und zum anderen hatte ich ethische Bedenken.

Klar, die KI-Chatbots bieten uns neue digitale Chancen, aber sie können auch destruktiv sein. Als Werbetexterin gehöre ich (gemeinsam z. B. mit Übersetzern) zu den Berufsfeldern, die als erstes von KI-Chatbots weggefegt wurden. Ich empfand es als unfair, dass sich OpenAI & Co. hemmungslos bei meinen Texten und Blogartikeln bedienten, um ihre Sprachmodelle zu trainieren – ohne mir aber etwas im Gegenzug zurückzugeben, wie das z. B. Googe jahrelang getan hatte (ich habe von Google zigtausende Klicks auf meine Website bekommen – und dadurch Kunden und Umsatz). Hinzu kamen noch die Bedenken bezüglich der Umwelt: Die KI-Rechenzentren brauchen Unmengen von Wasser und Strom. Und dann war da noch die Sache mit der Moral: Die „Move-fast-and-break-Things“-Mentalität ist halt nur zu einem gewissen Grad cool. Dieses Hin und Her bei der Frage, ob OpenAI jetzt nun gemeinnützig ist und der ganzen Menschheit zugute kommt – oder doch nicht, weil das große Geld winkt, hat meine Begeisterung ziemlich gedämpft. Menschheit, quo vadis?

In meinem Newsletter vom 11. März 2026 habe ich folgendes geschrieben:

OpenAI, das Unternehmen hinter ChatGPT, steht in der Kritik. Kurzgesagt: OpenAI-Präsident und Mitgründer Greg Brockman spendete im vergangenen Jahr rund 25 Millionen Dollar an ein Pro-Trump-Komitee. Damit zählt er zu den größten Einzelspendern aus der Tech-Branche an die MAGA-Bewegung. Dann der Deal mit dem Pentagon: Im Februar 2026 schloss OpenAI eine Vereinbarung mit dem US-Verteidigungsministerium. Auch die Einwanderungsbehörde ICE setzt ChatGPT-Technologie ein. Die Befürchtung: dass die Technologie für autonome Waffen und für die massenhafte Überwachung der Bevölkerung eingesetzt werden könnte.

Ursprünglich war Anthropic, der größte Wettbewerber von OpenAi, der KI-Lieferant des Pentagons. Aber: Anthropic weigerte sich, diesen Deal zu unterzeichnen. Anthropic wollte seine ethischen Nutzungsbedingungen nicht aufweichen. OpenAI hingegen setzte andere Prioritäten und, ZACK, war der Deal unterzeichnet!

Schau dir dieses englischsprachige-YouTube-Video an für die genauen Hintergründe.

Die Folge: Viele Leute kündigen jetzt ihr ChatGPT-Abo. Die Quit GPT-Bewegung hat schon über 4 Millionen Teilnehmer :-o

Viele von diesen Menschen wandern jetzt zu Anthropic ab. Das ist das Unternehmen, das den KI-Chatbot Claude entwickelt hat.

In den letzten Wochen höre und lese ich regelmäßig, dass Frauen KI 25 % langsamer adaptieren, als Männer. Und dass wir diesen „KI-Gender-Gap“ unbedingt schließen müssten, damit Frauen nicht schon wieder abgehängt werden. Schließlich sind „weibliche Jobs“ die ersten, die von der KI ersetzt werden: Virtuelle Assistenzen, Sekretärinnen-Jobs, Recherchen, Schreibtätigkeiten, Terminplanung usw. Was da oft für mich mitschwingt, ist der leise Vorwurf an Frauen, dass sie halt technisch nicht so versiert seien und sich doch einfach nur ein bisschen mehr mit KI beschäftigen müssten, um aufzuholen. Aber: Nicht die Technik ist das Problem! Frauen adaptieren KI wahrscheinlich deshalb langsamer, weil sie mehr moralische Bedenken haben. Fragen, wie Umweltschutz und gerechte Arbeitsbedingungen, sind für viele Frauen oft wichtiger als für Männer. Und: Frauen machen sich mehr Gedanken/Sorgen um die gesellschaftlichen Auswirkungen von KI. Dieses ungute Gefühl kann man nicht mit einem „Beginner-KI für Frauen“ beiseitewischen – es hat viel tiefliegendere Ursachen.

Und dann kommt da Anthropic daher, das Unternehmen hinter Claude, das von 7 ehemaligen und von OpenAI enttäuschten Mitarbeitern gegründet wurde. Was Anthropic von anderen KI-Firmen unterscheidet, ist der Ansatz namens „Constitutional AI“ – grundlegende Prinzipien und Verhaltensweisen werden in die KI selbst eingebaut, statt nachträglich hinzugefügt zu werden, um moralische Probleme auszubügeln. Das ist schon mal mehr, als OpenAI und andere KI-Unternehmen machen. Klar, auch Anthropic ist nicht perfekt: Da ist z. B. das ständige Angstmarketing von CEO Dario Amodei. Und dass die Anthropic-Server in den USA stehen, also einem Land, das mittlerweile offen feindselig gegenüber der EU auftritt, ist auch nicht gerade vertrauenserweckend. Ich sehe die Probleme und die Widersprüche.

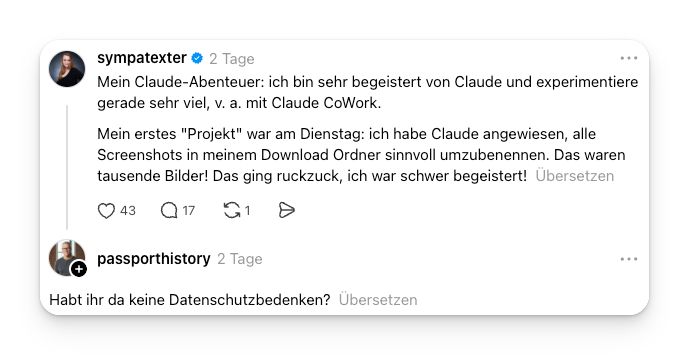

Und dennoch: für mich ist Claude die ethisch bessere Wahl, als OpenAI. Nachdem der Pentagon-Deal mit Anthropic geplatzt ist, wusste ich: Jetzt ist es Zeit für mich, zu Claude zu wechseln. So bin ich im März 2026 mit einem Kopfsprung in mein neues KI-Abenteuer gesprungen. Und jetzt, mit Claude, habe ich das Gefühl: Ja, die KI-Revolution ist jetzt bei mir wirklich angekommen! Jetzt ist KI für mich wirklich ein nützlicher Assistent – und nicht einfach nur ein Sprachmodell, das teilweise sehr unterschiedliche Tagesformen hat! Ich experimentiere begeistert mit Claude und übergebe ihm zig To-Dos rund um meinen Blog (hier ist eine Liste mit 10+ Aufgaben, die Claude schon für meinen Blog übernommen hat)! Und genau bei so einem Experiment wurde mir durch die Kommentare klar: Hier sind krasse Datenschutz-Themen, die ich selbst auch nicht gleich gesehen habe!

Wo entstehen auf deinem Blog überhaupt personenbezogene Daten und wo könnten diese ungewollt in ein KI-Tool fließen?

Nachrichten über dein Kontaktformular enthalten fast immer Name und E-Mail-Adresse, manchmal auch Telefonnummer oder konkrete Anliegen. Diese Daten landen häufig direkt in deinem WordPress-Backend oder per E-Mail in deinem Postfach – beides Orte, die du nicht leichtfertig einem KI-Tool zeigen solltest. Die einfachste Lösung: Nutze kein Kontaktformular! Und zwar aus zwei Gründen: Kontaktformulare sind oft ein Einfallstor für Spam. Und: Ich empfinde sie als „90er“ – also als veraltet. Lass die Leute einfach eine normale E-Mail schreiben, wenn sie dich kontaktieren wollen!

Wenn du einen Newsletter anbietest und ihn über ein Plugin in deine WordPress-Seite integrierst, ist die Abonnentenliste wahrscheinlich irgendwo in deinem Backend einsehbar. Dann gilt dasselbe Prinzip: Namen und E-Mail-Adressen sind hochsensibel und dürfen nicht unbeabsichtigt in KI-Prompts landen. Ich nutze für meinen Newsletter Active Campaign, mein Blog und mein Newsletter sind komplett getrennte Systeme. Über meinen Blog gibt es also keine Möglichkeit, die E-Mail-Adressen meiner Abonnenten auszulesen.

Betreibst du neben dem Blog auch einen Shop bzw. verkaufst digitale Produkte – und liegen alle diese Funktionen (Blog & Shop) bei einem Anbieter? Dann sind in deinem Blog-System möglicherweise Kaufhistorien, Rechnungsadressen oder Zahlungsinformationen einsehbar. Diese Daten haben in keinem KI-Tool etwas verloren – ohne ausdrückliche Rechtsgrundlage und entsprechende Schutzmaßnahmen. Ich nutze zum Verkaufen meiner Onlinekurse einen Zahlungsdienstleister, den ich nicht mit meinem Blog verbunden habe. Hier gibt es also für mich keine Datenschutz-Probleme.

Fotos von Kunden, Veranstaltungsteilnehmern oder Mitarbeitern, die du für deinen Blog verwendest, sind ebenfalls personenbezogene Daten. Wenn du solche Bilder in ein KI-Tool hochlädst – etwa um sie zu bearbeiten oder zu beschriften – brauchst du dafür eine Rechtsgrundlage, in der Regel die ausdrückliche Einwilligung der abgebildeten Personen.

Tools wie Google Analytics erfassen das Verhalten deiner Besucher. Diese Daten fließen zwar nicht direkt in Claude – aber wenn du Berichte oder Exports davon in ein KI-Tool eingibst, um sie analysieren zu lassen, können auch dort personenbezogene oder personenbeziehbare Informationen wie z. B. IP-Adressen enthalten sein. Eine Lösung könnte sein, dass du Analytics-Tools nutzt, die sehr datensparsam sind, wie z. B. Statify oder Koko Analytics.

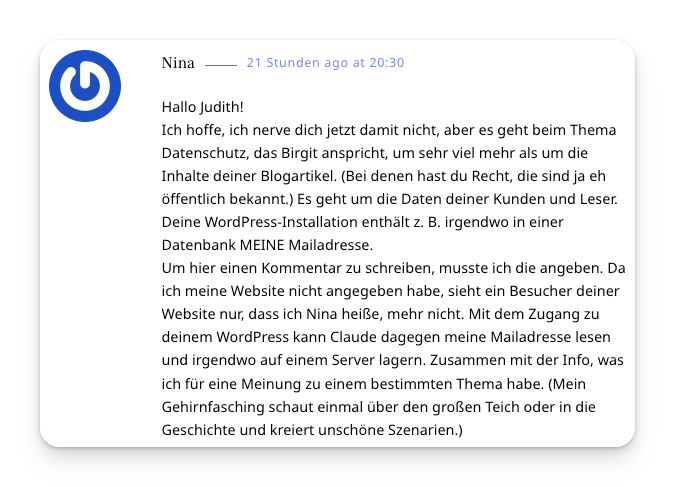

Wer unter deinen Artikeln kommentiert, hinterlässt in deiner WordPress-Datenbank Name, E-Mail-Adresse und ggf. Website-URL. Im Frontend sehen Besucher nur den Namen und die Website, aber im eingeloggten Backend sind die E-Mail-Adressen sichtbar. Gibst du einem KI-Tool über eine Browser-Extension Zugriff auf dein Backend, kann es diese Daten erfassen, ohne dass du es bewusst steuerst. Das ist der wahrscheinlich größte Datenschutz-Stolperstein für Blogger! Daher sind wir jetzt auch gleich bei einer sehr spannenden Frage:

Ein Datenschutzaspekt, der beim Einsatz von KI-Tools oft übersehen wird: die Daten deiner Blog-Kommentatoren. Wenn jemand unter deinem Blogartikel kommentiert, speichert WordPress standardmäßig Name, E-Mail-Adresse und ggf. Website-URL in deiner Datenbank. Diese E-Mail-Adresse ist für Besucher deines Blogs nicht sichtbar, aber sie ist im eingeloggten WordPress-Backend sichtbar, zum Beispiel in der Kommentarverwaltung.

Das Problem mit Browser-basierten KI-Tools: Wenn du ein KI-Tool wie Claude über eine Browser-Extension nutzt und dabei im WordPress-Backend arbeitest, kann das Tool theoretisch alles erfassen, was auf dem aktiven Tab sichtbar ist. Bist du dabei auf der Kommentarverwaltungsseite (/wp-admin/edit-comments.php), wären E-Mail-Adressen deiner Kommentatoren Teil des erfassten Seitencontents.

Das bedeutet: Selbst wenn du Claude nur für das Überarbeiten von Artikeln nutzen möchtest, können bei unvorsichtiger Nutzung personenbezogene Daten Dritter übermittelt werden – ohne dass du es merkst und ohne dass diese Personen eingewilligt haben.

Was du als Blogger tun kannst:

Was du als Kommentator tun kannst:

Und was ist mit dem LLM-Training? Für das Training großer Sprachmodelle wurden öffentliche Webseiten in großem Umfang gecrawlt. Kommentartexte und angezeigte Namen waren dabei öffentlich sichtbar und könnten erfasst worden sein. E-Mail-Adressen hingegen zeigt WordPress im Frontend standardmäßig nicht an – sie waren also für Crawler in der Regel nicht zugänglich. Eine Ausnahme: wenn jemand seine E-Mail-Adresse im Kommentartext selbst geschrieben hat.

Das ist wohl die häufigste Frage, die sich stellt, wenn man Claude für die Arbeit mit Kundenprojekten nutzt. Die kurze Antwort: Ja, in der Regel brauchst du eine Rechtsgrundlage – und meistens ist das die Einwilligung.

Nach der Datenschutz-Grundverordnung (DSGVO) darfst du personenbezogene Daten deiner Kunden nur verarbeiten, wenn du dafür eine gültige Rechtsgrundlage hast (Art. 6 DSGVO). Wenn du z. B. Fotos von Kunden, deren Namen, E-Mail-Adressen, Bestellhistorien oder andere personenbezogene Informationen in Claude eingibst, verarbeitest du diese Daten – und Anthropic erhält sie als Drittanbieter.

Passend dazu ist der folgende Kommentar:

Ich habe hunderte Dateien in meinem Download-Ordner. Soll ich jetzt alle meine Kunden (ebenfalls hunderte) um Erlaubnis fragen, wenn ich diesen Ordner von KI sortieren lassen will? Und was, wenn nur eine Person widerspricht, die vielleicht in meinen Dateien gar nicht vorkommt – was ich aber nur herausfinde, wenn ich die KI meine Bilder sortieren lasse?

Die Vorstellung, dass wir jeden Kunden einzeln um Erlaubnis bitten, bevor wir z. B. die KI unsere eigenen Dateien sortieren lassen, ist in der Praxis schlicht nicht umsetzbar. Das wissen auch Datenschutzbehörden. Was tatsächlich zählt, sind verhältnismäßige und vernünftige Maßnahmen:

Laut der Datenschutzrichtlinie von Anthropic (Stand: Januar 2026) können deine Eingaben (Prompts) und Ausgaben (Outputs) für das Training der Modelle verwendet werden – es sei denn, du widersprichst dem aktiv. Wenn du Claude.ai als Privatperson oder im Rahmen eines Verbraucherkontos nutzt, kannst du in deinen Kontoeinstellungen unter „Privacy Settings“ das Training mit deinen Daten deaktivieren (Opt-out).

Für gewerbliche Kunden, die die Anthropic API oder Claude for Work nutzen, gelten andere Regelungen: dort agiert Anthropic als Auftragsverarbeiter, und die Daten werden standardmäßig nicht für das Training verwendet.

Praktischer Tipp: Wenn du sensible Kunden- oder Geschäftsdaten verarbeitest, nutze nach Möglichkeit die Business-/API-Version und überprüfe die entsprechenden Datenverarbeitungsverträge (AVV/DPA).

Wenn du Claude im geschäftlichen Bereich einsetzt und dabei personenbezogene Daten Dritter (z. B. deiner Kunden) verarbeitest, ist die Frage nach einem Auftragsverarbeitungsvertrag (AVV) – auf Englisch: Data Processing Agreement (DPA) – hochrelevant.

Nach Art. 28 DSGVO bist du verpflichtet, mit jedem Auftragsverarbeiter einen AVV abzuschließen. Anthropic bietet für seine kommerziellen Kunden entsprechende Verträge an. Wenn du Claude über die API oder Claude for Work/Teams nutzt, kannst du bei Anthropic einen solchen Vertrag anfragen. Für reine Privatnutzer oder Kleinunternehmer, die nur die öffentliche Version auf Claude.ai nutzen, liegt die Situation komplizierter – hier solltest du genau abwägen, welche Daten du überhaupt eintippst.

Der DPA gilt nur für kommerzielle Pläne (API, Team, Enterprise) und nicht für Free- oder Pro-Accounts (also die Tarife, die die meisten Blogger haben). Wenn du Claude als Blogger mit einem Pro-Account nutzt, greift stattdessen die allgemeine Datenschutzrichtlinie, und du bist nicht automatisch durch einen AVV abgesichert. Wenn du mit Claude Pro an Inhalten arbeitest, die personenbezogene Daten Dritter berühren könnten (zum Beispiel Kundendaten, E-Mail-Adressen von Kommentatoren, Leserdaten) dann fehlt dir die DSGVO-konforme Vertragsgrundlage. Übrigens: Die Max-Version für 100 Dollar reicht auch nicht, das gilt auch noch als Consumer-Produkt und bietet deshalb keinen AVV.

Deine Optionen:

Faustregel: Keine personenbezogenen Kundendaten in Claude eingeben, ohne vorher die rechtliche Grundlage zu klären und ggf. einen AVV abzuschließen. Denn: Auch wer „bezahlt“, also Pro-Mitglied ist, hat damit noch keine kommerzielle Absicherung im DSGVO-Sinne.

Um Claude mit einem AVV (Auftragsverarbeitungsvertrag) nutzen zu können, brauchst du einen kommerziellen Tarif. Die kleinste dieser Optionen mit AVV ist der Team Plan. Dieser kostet aktuell 25 Dollar pro Person und Monat bei jährlicher Abrechnung, oder 30 Dollar bei monatlicher Abrechnung. Mindestens 5 Personen sind erforderlich, das macht also mindestens 125 Dollar pro Monat (jährlich) als Einstieg. Für Einzelblogger gibt es aktuell keine bezahlbare Mittelweg-Option mit vollem AVV-Schutz. Das ist eine Lücke im Angebot von Anthropic: Wer solo arbeitet und trotzdem datenschutzkonform arbeiten möchte, steht vor einem echten Datenschutz-Problem.

Anthropic ist ein US-amerikanisches Unternehmen mit Sitz in San Francisco. Das bedeutet, dass deine Daten in der Regel auf Servern in den USA verarbeitet und gespeichert werden. Für europäische Nutzer stellt sich daher die Frage der Drittlandübermittlung nach Art. 44 ff. DSGVO.

Anthropic gibt in seiner Datenschutzrichtlinie an, dass Datentransfers in die USA und andere Länder außerhalb des EWR auf Basis von Standardvertragsklauseln (SCCs – Standard Contractual Clauses) oder Angemessenheitsbeschlüssen der EU-Kommission erfolgen. Für europäische Nutzer (EWR, UK, Schweiz) ist die zuständige Datenverantwortliche Anthropic Ireland, Limited mit Sitz in Dublin.

Das bedeutet: Anthropic hat rechtliche Mechanismen implementiert, um die Datentransfers DSGVO-konform zu gestalten. Dennoch solltest du als Unternehmer diese Transfers in deinem Verarbeitungsverzeichnis dokumentieren und in deiner Datenschutzerklärung transparent machen.

Ok, ich gebe zu: Dieses Kapitel habe ich mithilfe der KI geschrieben 😄

Die DSGVO gewährt betroffenen Personen zahlreiche Rechte – darunter das Recht auf Auskunft, Berichtigung, Löschung („Recht auf Vergessenwerden“), Einschränkung der Verarbeitung und Datenportabilität. Das wird bei KI-Tools besonders kompliziert, weil Eingaben möglicherweise für das Modelltraining verwendet wurden.

Als Verantwortliche(r) bist du verpflichtet, Betroffenenanfragen entgegenzunehmen und weiterzuleiten. Anthropic bietet Nutzern die Möglichkeit, Anfragen zur Löschung oder Auskunft an privacy@anthropic.com zu stellen. Einzelne Konversationen können direkt in der App gelöscht werden und werden laut Anthropic innerhalb von 30 Tagen auch aus den Backend-Systemen entfernt.

Wichtig: Wenn Daten bereits ins Modelltraining eingeflossen sind, ist eine vollständige Löschung technisch möglicherweise nicht durchführbar. Anthropic weist in seiner Datenschutzrichtlinie selbst darauf hin, dass aufgrund der Komplexität großer Sprachmodelle nicht immer garantiert werden kann, dass alle personenbezogenen Daten vollständig aus den Modellen entfernt werden können.

Die DSGVO stuft bestimmte Datenkategorien als besonders schützenswert ein (Art. 9 DSGVO): dazu gehören Gesundheitsdaten, biometrische Daten, Daten zur religiösen Überzeugung, zur ethnischen Herkunft, zu politischen Meinungen oder zur sexuellen Orientierung.

Für diese Datenkategorien gelten deutlich strengere Anforderungen. Eine Verarbeitung ist nur unter engen Voraussetzungen erlaubt, z. B. mit ausdrücklicher Einwilligung oder wenn eine rechtliche Verpflichtung besteht. Das Eingeben von Gesundheitsdaten deiner Kunden oder Patienten in Claude ist ohne entsprechende Rechtsgrundlage und technisch-organisatorische Schutzmaßnahmen in der Regel nicht zulässig.

Auch Anthropic selbst schließt in seiner Nutzungsrichtlinie die missbräuchliche Verwendung von sensiblen Daten wie biometrischen oder Gesundheitsdaten ohne entsprechende Einwilligung aus.

Ich erhebe solche besonders sensiblen Daten nicht – und ich vermute, dass die meisten Blogger das nicht tun. Aber: Das Thema der sensiblen Daten wird für dich relevant, wenn du in einem Bereich arbeitest, der regelmäßig solche Daten berührt, z. B. als Ärztin, Therapeut oder Versicherungsmaklerin. Es empfiehlt sich, sensible Kundendaten nicht mit Plugins mit dem Blog zu verbinden. Halte sie am besten komplett getrennt!

Stell dir vor, du erfährst, dass jemand deine E-Mail-Adresse, deinen Namen oder andere persönliche Informationen in Claude eingegeben hat, ohne dein Wissen. Was passiert dann mit diesen Daten? Können sie wildfremde Leute irgendwo im Internet wiederfinden? Keine Sorge: Deine Daten sind nicht öffentlich einsehbar.

Claude ist kein öffentliches Verzeichnis. Was jemand in Claude eingibt, landet nicht im Internet und ist nicht für andere Nutzer sichtbar. Claude gibt die Informationen aus einem Gespräch nicht an andere Nutzer weiter und veröffentlicht sie nicht.

Was stattdessen passiert: Die eingegebenen Daten werden als Teil der Konversation an Anthropics Server übertragen, dort verarbeitet und, je nach Einstellungen, für eine bestimmte Zeit gespeichert. Andere Menschen, die Claude nutzen, haben keinen Zugriff darauf.

Was aber trotzdem passiert sein könnte: Auch wenn deine Daten nicht öffentlich sind, gibt es berechtigte Datenschutzfragen:

Was du tun kannst: Als betroffene Person hast du nach der DSGVO Rechte – auch gegenüber Anthropic:

Ein Haken dabei: Wenn Daten bereits ins Modelltraining eingeflossen sind, ist eine vollständige Löschung technisch nicht immer möglich – das räumt Anthropic selbst ein.

Die wichtigste Erkenntnis: Das eigentliche Risiko liegt nicht darin, dass deine Daten plötzlich öffentlich auftauchen. Das Risiko liegt darin, dass sie ohne dein Wissen und ohne Rechtsgrundlage verarbeitet wurden und dass du als betroffene Person darüber keine Kontrolle hattest. Genau das ist der Kern der DSGVO: nicht nur Geheimhaltung, sondern Selbstbestimmung über die eigenen Daten.

Angenommen, du nutzt Claude nur für „einfache“ Tätigkeiten rund um deinen Blog:

Dann findet keine Verarbeitung personenbezogener Daten statt, und die DSGVO-Informationspflicht greift nicht. Die Informationspflicht nach Art. 13/14 DSGVO greift nur, wenn du personenbezogene Daten verarbeitest.

Aber: Wenn du Claude im geschäftlichen Kontext einsetzt und dabei personenbezogene Daten verarbeitest, musst du darüber in deiner Datenschutzerklärung informieren. Das ergibt sich aus der Informationspflicht nach Art. 13/14 DSGVO. Denn: Bist du wirklich sicher, dass keine Personendaten in die KI einfließen?

Das ist in der Praxis schwerer zu garantieren als es klingt. Denn personenbezogene Daten können unbeabsichtigt einfließen, zum Beispiel wenn du:

Ich kann aus rechtlichen Gründen hier keinen Textvorschlag für dich formulieren. Aber folgendes solltest du in deine Datenschutzerklärung aufnehmen: den Einsatz von Claude/Anthropic als Tool zur Datenverarbeitung, den Zweck der Verarbeitung, die Rechtsgrundlage, den Hinweis auf die Drittlandübermittlung in die USA samt der eingesetzten Schutzmaßnahmen (SCCs), sowie einen Verweis auf die Datenschutzrichtlinie von Anthropic. Wenn du einen Team-Plan hast und die AVV abgeschlossen hast, solltest du Anthropic auch in deinem Verarbeitungsverzeichnis als Auftragsverarbeiter aufführen.

Die DSGVO wurde 2018 verabschiedet, also Jahre bevor ChatGPT, Claude und Co. die Welt auf den Kopf stellten. Damals traf sie die Blog- und Forenszene hart. Obwohl die politische Intention eher auf große Datenkraken wie Facebook und Google abzielte, galt die Verordnung für alle – auch für kleine Blogs mit Kommentarfunktion. Denn wer Kommentare erlaubt, speichert automatisch Namen, E-Mail-Adressen und IP-Adressen. Viele Bloggerinnen und Forenbetreiber hatten Angst vor Abmahnungen und schalteten ihre Seiten ab. Ein echter Verlust für die digitale Öffentlichkeit. Und heute? Dieselbe Kommentarfunktion, die damals das Datenschutzproblem war, ist heute wieder das Problem – nur diesmal nicht wegen der Speicherung, sondern wegen der KI-Verarbeitung.

Daher muss man sich heute fragen: Ist die DSGVO überhaupt noch zeitgemäß? Und was ändert sich jetzt mit dem neuen EU AI Act?

Die DSGVO gilt – auch für KI

Die kurze Antwort: Die DSGVO ist nicht überholt, aber sie wurde nie speziell für KI gemacht. Die DSGVO kennt keine Ausnahme für KI-Systeme. Im Gegenteil: Gerade bei KI-Anwendungen ist besondere Vorsicht geboten, da diese oft große Datenmengen verarbeiten und intransparent arbeiten.

Das bedeutet: Alles, was ich bisher aufgeführt habe – Rechtsgrundlage, AVV, Drittlandübermittlung – gilt genauso für KI-Tools wie für jede andere Software.

Der EU AI Act: Das erste KI-Gesetz der Welt

Europa hat reagiert und ein eigenes KI-Gesetz geschaffen. Der EU AI Act ist seit August 2024 in Kraft und verfolgt einen risikobasierten Ansatz – je gefährlicher ein KI-System eingestuft wird, desto strenger die Anforderungen.

Die wichtigsten Stufen im Überblick:

Seit Februar 2025 sind bestimmte KI-Systeme in der EU vollständig verboten, wie z. B. Social Scoring, manipulative KI und biometrische Echtzeit-Fernidentifikation. Seit August 2025 müssen Anbieter von allgemeinen KI-Modellen wie ChatGPT, Gemini oder Claude ihre Trainingsdaten dokumentieren und mit dem EU AI Office kooperieren. Ab August 2026 gelten strenge Dokumentations- und Überwachungspflichten für sogenannte Hochrisiko-KI-Systeme, etwa im Personalwesen oder bei der Kreditvergabe.

Was bedeutet das für Claude und andere Chatbots?

KI-Modelle mit allgemeinem Verwendungszweck wie ChatGPT, Gemini oder Claude unterliegen seit August 2025 besonderen Transparenz- und Urheberrechtsvorschriften. Anbieter müssen offenlegen, mit welchen Daten ihre Modelle trainiert wurden. Data-unplugged

Für uns als Nutzerinnen bedeutet das: Wir dürfen erwarten, transparenter informiert zu werden – darüber, wie unsere Daten verwendet werden und wie das Modell trainiert wurde.

Ergänzen sich DSGVO und AI Act – oder widersprechen sie sich?

Der AI Act (bzw. KI-Verordnung) ersetzt nicht die DSGVO, sondern ergänzt sie. Beide Regelwerke müssen gleichzeitig beachtet werden. Während die DSGVO personenbezogene Daten schützt, reguliert der AI Act KI-Systeme als Technologie. Für normale Bloggerinnen wie dich und mich bedeutet das vor allem: Die Anforderungen werden nicht weniger, sondern mehr.

Die Gesetzgebung ist noch nicht KI-ready

Die DSGVO bietet einen soliden Rahmen für personenbezogene Daten im digitalen Prä-KI-Zeitalter, war aber nicht für die Welt generativer KI gedacht. Ein konkretes Problem: Wenn Daten einmal ins Training eines Sprachmodells eingeflossen sind, ist ein vollständiges Löschen (wie es das DSGVO-Recht auf Vergessenwerden eigentlich vorsieht) technisch kaum möglich. Hier klaffen Gesetz und Realität noch auseinander.

Der EU AI Act schließt einige dieser Lücken, aber er rollt erst schrittweise bis 2027 aus. Wir befinden uns also gerade in einer Übergangsphase, in der die Technologie der Gesetzgebung davongaloppiert.

Was das für dich bedeutet

Als Nutzerin von KI-Tools bist du nicht allein mit diesen Fragen. Die Regeln werden klarer, aber es braucht noch Zeit. Was du jetzt tun kannst: bewusst mit deinen Daten umgehen, die Einstellungen deiner KI-Tools prüfen und im Zweifel weniger statt mehr eingeben.

Anthropic ist kein obskurer Akteur, sondern ein reguliertes Unternehmen mit klaren Datenschutzrichtlinien. Aber wie bei jedem digitalen Tool gilt: Bewusstsein darüber, was du eingibst, ist die beste Datenschutzmaßnahme. Mit den richtigen Maßnahmen, also einem AVV, der Opt-out-Option beim Training, einer angepassten Datenschutzerklärung und dem bewussten Umgang mit sensiblen Daten, kannst du Claude DSGVO-konform einsetzen.

Meine wichtigsten Empfehlungen auf einen Blick:

ÜBER MICH: Blog like nobody’s reading! Das ist meine Philosophie, mit der ich mein Content-Imperium aufbaue. Seit meinem ersten Blogartikel am 1. August 2005 sind über 1.200 Blogartikel dazugekommen – und eine glasklare Positionierung, eine starke Reputation und ein erfolgreiches Familien-Online-Business. Bloggen ist für mich Hobby, Leidenschaft und persönliche Weiterentwicklung. Und erst danach mein Akquisemotor und Umsatzbringer. Im Laufe meines 20-jährigen Blog-Abenteuers habe ich Begriffe geprägt, wie Content-Ängst und dynamisches Bloggen. Heute bin ich das beste Beispiel dafür, dass wir mit Persönlichkeit, Mut und Verletzlichkeit einen profitablen Blog aufbauen können, auch ohne den schwarzen Gürtel im Technik-Kungfu zu haben. Von der Festan(gst)stellung zum Leben in kreativer Freiheit: Dein Blog machts’s möglich!

Mehr über mich erfährst du hier!

13 Comments

Vielleicht könnte man das Problem ja auch einfach dadurch lösen, dass die Leute kommentieren können, aber dabei nicht ihre Mailadresse eingeben müssen. (Dann können sie aber auch nicht benachrichtigt werden, wenn es Antworten gibt.)

Oder man weist sie darauf hin, dass sie nicht ihre richtige Adresse angeben sollen, sondern eine zusätzliche (z.B. Alias-Adresse), von der aus sie dann eventuelle Antworten an die richtige automatisch weiterleiten. Das mache ich immer so. Die richtige landet so nicht in einer fremden Datenbank. (Und wenn man über die „falsche“ irgendwann Spam und Fishing-Mails bekommt, dann weiß man, dass das Leck bei einer der Websites war, wo man sie benutzt hat …)

Oder: die Mailadressen befinden sich doch bestimmt alle in der gleichen Datenbank irgendwo in deinem Account bei deinem Provider. Da könnte man reingehen (FTP-Zugang oder so, glaube ich), sie „rauskopieren“ und irgendwo speichern. Sie dann löschen, bevor man die KI loslässt, und sie hinterher, wenn die KI mit der Arbeit fertig ist, wieder drauftun. (Das ist bei umfangreichen KI-Arbeiten bestimmt weniger Arbeit, als das, was die KI machen soll, selbst zu machen.)

Alles sehr, sehr spannend. Anthropic hat selbst Sicherheitsratschläge veröffentlicht und sagt, dass man die KI möglichst bei der Arbeit beaufsichtigen soll, damit sie nicht Opfer von prompt injections wird und quasi „hypnotisiert“ von in irgendwelchen Dokumenten versteckten Anweisungen plötzlich gefährlichen Blödsinn macht.

Liebe Grüße

Nina

Vielen Dank, dass du dich da so reingekniet hast. Für mich ist das alles eher Bestätigung, diese KI-Tools nicht einzusetzen, wie bequem und zeitsparend das auch sein mag. Wenn ich dann in der Abwägung auf die Kommentarfunktion und damit den Austausch mit echten anderen Menschen verzichten sollte, ist meine Priorität nicht bei der Aufwandsersparnis.

Was deine Erkenntnisse zeigen: Wie viel die meisten von uns gar nicht wissen, wenn es um diese Sprachmodelle geht, wie verführerisch es ist, sie zu nutzen und wie weit wir uns dann in rechtlich schwierige Bereiche begeben.

Liebe Grüße

Angela

Ich glaube, es ist nicht notwendig, komplett auf die KI zu verzichten. Wir müssen einfach nur schauen, dass wir Claude Cowork z. B. nicht in unserer Kommentarverwaltung arbeiten lassen. Wir müssen also erkennen, wo Datenschutz-Themen aufkommen könnten und hier verantwortungsbewusste und informierte Entscheidungen treffen. Die KI wegen Datenschutz nicht zu nutzen, fühlt sich für mich an, wie das Kind mit dem Bade auszuschütten. Viele KI-Szenarien sind auch komplett DSGVO-safe, wie z. B. als ich letzte Woche Claude Cowork angewiesen habe, alle meine Wortspiel-Artikel zu einem einzigen Blogartikel zusammenzufassen: Das waren 809 Blogartikel, die Claude in ca. 30 Minuten zusammengeführt hat. Das hätte ich NIEMALS manuell gemacht, das wäre mir viel zu anstrengend gewesen! Ich bin so dankbar, dass es jetzt solche Möglichkeiten gibt, manuelle und repetitive Tätigkeiten so schnell erledigen zu lassen.

Nach dem großen Bloggersterben mit der DSGVO-Welle 2017 hat es bei mir Jahre gedauert, bis das „Salz in der Bloggersuppe“ = die Kommentare wieder halbwegs funktioniert haben. Eine Mail direkt an mich, fand ich noch nie verlockend, sondern freue mich immer über den Kommentarausstausch direkt im blog.

Wenn das durch die KI-Aktivitäten nun schrittweise wieder empfohlen wird, die Kommentarfunktionen zu deaktivieren und alle bisherigen Kommentare (das sind bei mir nach 16 Bloggerjahren fast 12.000) zu löschen, würde das die Bloggerfreude erheblich trüben ….

Das wird ja nur empfohlen, wenn du Claude/der KI Zugang zu deinem WordPress-Backend gibst. So lange du mit der KI nur „von außen“ an deiner Website arbeitest, musst du an der Kommentarfunktion nichts ändern.

Du kannst die KI zum Beispiel bitten, auf deine Website zu gehen und dir einen Blogartikel zu einem vorgegebenen Thema in deinem Stil zu erstellen. Den überarbeitest du dann und fügst ihn selbst in WordPress ein.

Für mich ist das Besondere ja gerade das agentische Arbeiten-Lassen an meinem Blog. Die Funktion, von außen am Blog zu arbeiten, führt ja dazu, dass ich alles selbst umsetzen muss. Genau das möchte ich vermeiden.

Ich habe letzte Woche Claude 809 Blogartikel zu einem einzigen Blogartikel zusammenfassen lassen. Hätte ich das selbst gemacht, hätte das einen sehr großen Arbeitsaufwand bedeutet – und ich hätte das, ehrlich gesagt, selbst nie gemacht. Wäre mir zu viel Arbeit gewesen.

Und: Mir geht es bei KI gerade NICHT um das Schreiben von Blogartikeln, das mache ich sehr gerne selbst (ok, ich lasse mir bei Expertenartikeln gerne eine erste Text-Version von KI erstellen, die ich dann massiv überarbeite. Das fällt mir oft leichter, als einen Blogartikel von 0 anzufangen).

Es gibt so viele Möglichkeiten, KI/Claude agentisch bei unserem Blog einzusetzen – aber können wir garantieren, dass die KI dann nicht doch auf die Kommentarverwaltung geht und die E-Mail-Adressen ausliest? 🤔 Wenn wir KI immer nur außen am Blog arbeiten lassen, nutzen wir die Möglichkeiten von KI vielleicht zu einem Prozent. Ich möchte mir mit agentischer KI v. a. die lästige Arbeit abnehmen lassen.

Danke für diesen ausführlichen Beitrag!

Ich arbeite ja auch gerne mit KI (und habe Claude nach OpenAIs kürzlichen Entscheidungen für mich wiederentdeckt – das hat sich in den letzten Monaten echt gemausert!). Aber Zugang zu meinem Backend gebe ich dem Tool nicht, aus Datenschutz- und auch aus Sicherheitsgründen.

Ich fände es eine traurige Entwicklung, wenn mehr Blogger ihre Kommentarfunktion abschalten würden, nur um LLMs bedenkenlos Zugriff auf ihr Backend zu gewähren… dieser Austausch ist sooo wichtig, finde ich!

Genau das! Ich kommentiere sehr gerne und bekomme auch gerne Kommentare. Ohne Austausch macht Bloggen für mich deutlich weniger Sinn, meine Texte sollen ja keine Einbahnstraße sein.

Zugang zum Backend bekommt Claude bei mir nur, wenn ich selbst eingeloggt bin. Dabei hat Claude nur Zugang zu dem einen Tab, den ich freigebe. Und Claude fragt immer nach Berechtigungen, wenn er was neues öffnen muss. Das heißt also, dass Claude sich nicht einfach so auf die Kommentarübersicht klicken kann, um dort die E-Mail-Adressen auszulesen.

Einmal, bei einem komplexen Blog-Job, hat mich Claude gefragt, ob ich ihm meine Login-Daten für WordPress gebe. Aber, pfff, mache ich natürlich nicht 😄

Ja, die Kommentarfunktion auszuschalten, fände ich auch sehr schade. Auf meinem Blog haben sich auch schon tausende Kommentare angesammelt. Vielleicht gibt es ein WordPress-Plugin, mit dem ich die E-mail-Adressen in der Kommentarfunktion löschen kann. Mal schauen.

Wow! Wow, wow, wow!!! Bitte einmal einen großen Konfetti-Regen über den Bildschirm schicken!!! Ich bin BEGEISTERT! DANKE! (Dass du sooo auf Anregungen deiner Leser eingehst. Der Hammer.)

KI ist toll, aber halt auch sehr verführerisch. Wenn ein Tool mir in 4 Minuten langweilige, zeitraubende Arbeit erledigt, die ich monatelang vor mir hergeschoben habe, besteht natürlich die Gefahr, dass ich vor lauter Begeisterung nicht an mögliche Gefahren denke.

Wunderbar, wie ausführlich du das alles darstellst. Damit positionierst du dich und deinen Blog auf der „Gewinner-Seite“ der KI. Und irgendwann haben wir wahrscheinlich eine gleichwertige, europäische Alternative. (Mistral arbeitet daran, richtet sich jedoch eher an Unternehmen, was aber nicht schlecht sein kann, da die eher zuverlässigen Datenschutz fordern als Privatpersonen.)